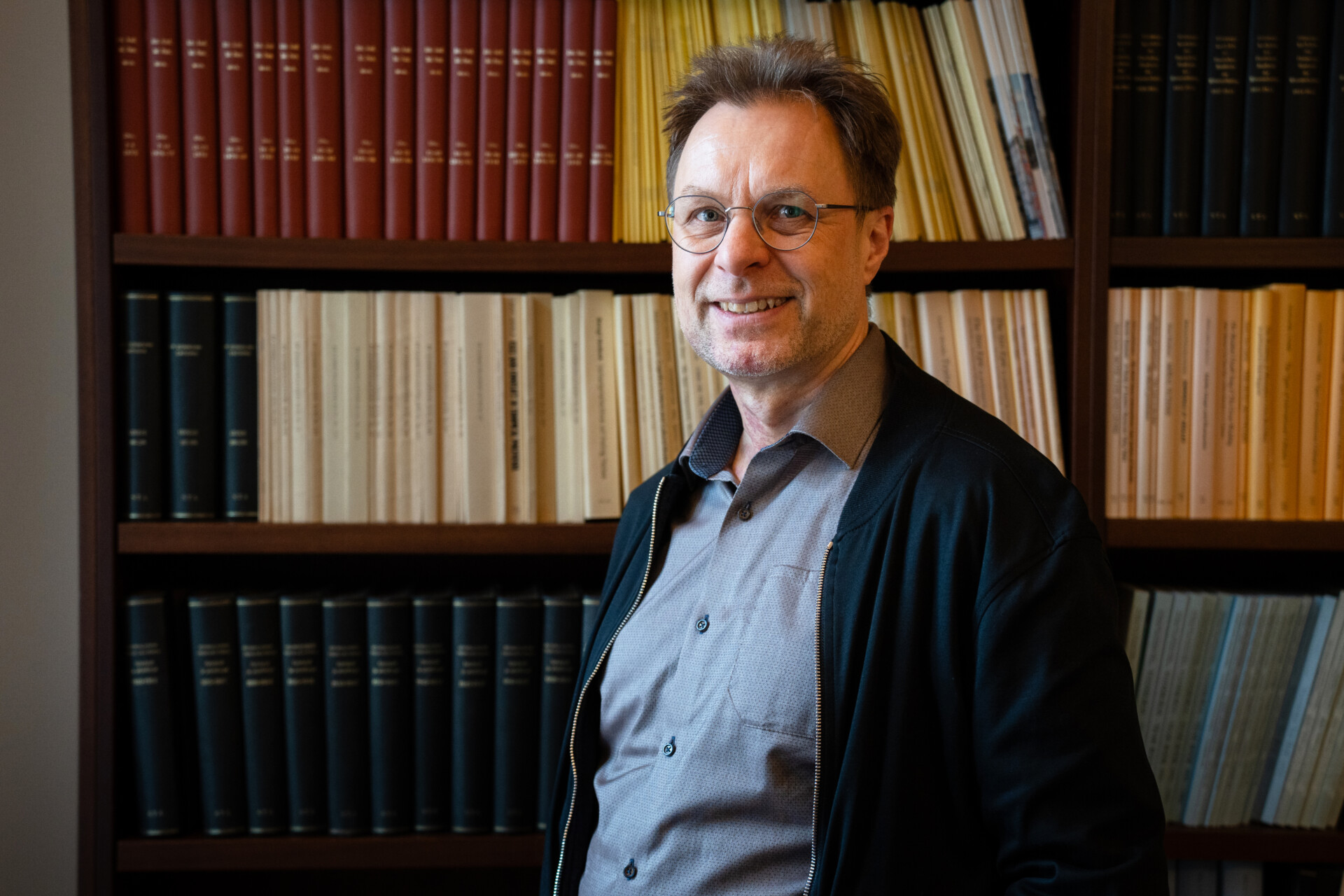

Yhteiskuntatieteilijä Mikko Rask kertoi Suomalaiselle Tiedeakatemialle ChatGPT:n potentiaalista ja riskeistä tutkimustyössä. Hänen mielestään tutkijoiden ohjeistus tekoälyn käyttöön on puutteellista.

Helsingin yliopiston Kuluttajatutkimuskeskuksen tutkija Mikko Rask on perehtynyt ChatGPT:n käyttöön osana tutkimustyötä. Kokeillessaan sovellusta relevantin tutkimuskirjallisuuden etsimiseen hän hämmentyi suuresti.

”Pyysin sitä etsimään linkkejä osallisuuden arviointiin liittyviin artikkeleihin. Siellä oli yksi, jonka tunnistin: Sherry Arnsteinin klassikkoartikkeli ”Ladder of Participation” vuodelta 1969, mutta siinä oli väärä vuosiluku. Mietin, onko Arnstein päivittänyt artikkelinsa ja avasin linkin. Se johti feikkiartikkeliin, joka oli feikkijournaalissa”, Rask kertoo.

Kokeneena tutkijana Rask tunnisti väärennöksen. Kyseessä on hänen tutkimusalallaan arvostettu ja tunnettu teksti, eikä väärennöksen sisältö vastannut alkuperäistä. Mikäli esimerkiksi joku Raskin opiskelijoista olisi päätynyt samaan tilanteeseen, väärennös olisi voinut mennä läpi.

Tapaus alleviivaa kielimallien keskeistä ongelmaa: tekoälyn suoltamaan tietoon ei voi luottaa. Siitä huolimatta Rask näkee kielimalleissa valtavasti potentiaalia yhteiskuntatutkijoille.

”Kielimalli auttaa valtavasti meitä vanhan kaartin tutkijoita, jotka olemme jo perillä oman alamme keskeisistä ajattelutavoista, argumenteista ja lähteistäkin.”

”Kielimalli auttaa valtavasti meitä vanhan kaartin tutkijoita, jotka olemme jo perillä oman alamme keskeisistä ajattelutavoista, argumenteista ja lähteistäkin.”

Kokemattomille tutkijoille ChatGPT:n käyttö tiedonhaussa luo enemmän riskejä, sillä he eivät välttämättä ole vielä tietoisia tutkimansa tieteenalan keskeisistä kysymyksistä, keskusteluista ja keskustelijoista.

Raskin näkemys on, että ChatGPT toimii tällä hetkellä hyvin reflektoinnin ja ideoinnin tukena kaikille tutkijoille. Faktoja siltä ei kannata kysyä, sillä vuosiluvut ja nimet menevät usein metsään.

Mihin tutkijat käyttävät kielimalleja?

Mikko Rask teki viime vuonna kyselytutkimuksen kielimallien käytöstä Helsingin yliopiston Kuluttajatutkimuskeskuksessa, jonka johtoryhmään hän itse kuuluu. Keskuksen 40–50 tutkijasta kyselyyn vastasi 33 tutkijaa. Kahden kyselykierroksen perusteella Rask huomasi generatiivisia kielimalleja hyödyntävien työkalujen kasvattaneen suosiotaan tutkijoiden keskuudessa.

”Reilusti yli kolmannes tutkijoista käyttää ChatGPT:tä editoinnin välineenä. Esimerkiksi englannin kielen tasoa pystyy nostamaan todella helposti kielimallin avulla”, Rask kertoo.

”Reilusti yli kolmannes tutkijoista käyttää ChatGPT:tä editoinnin välineenä.”

Reilu kymmenen prosenttia tutkijoista kertoi käyttäneensä kielimallia myös teoreettisen viitekehyksen rakentamisessa ja käsitteellistämisessä. Tutkimusdatan keräämiseen ja analysointiin tekoälytyökaluja ei puolestaan juuri ollut käytetty.

Tutkimuksen ideointia vaativissa työvaiheissa on hyödyllistä pallotella ajatuksia esimerkiksi toisen tutkijan kanssa. Näissä tilanteissa myös ChatGPT voi olla erinomainen keskustelukaveri.

”Yksi tutkijoistamme kertoi käyttävänsä sitä metaforien rakenteluun. Kun kuvataan jotakin ilmiötä, haetaan siihen analogioita, metaforia tai erilaisia käsitteellistämisen tapoja, on ChatGPT väsymätön keskustelukumppani. Ei kollegoja voi rasittaa sellaisella loputtomalla dialogilla”, Rask sanoo.

Ala on vielä villi länsi

Kielimallien käyttöön liittyy edelleen paljon avoimia yksityisyydensuojaan liittyviä kysymyksiä. Monet tekoäly-yhtiöt käyttävät sovelluksiin syötettävää materiaalia malliensa jatkokoulutukseen. Tästä syystä ChatGPT:lle ei esimerkiksi ole suositeltavaa syöttää arkaluonteista tietoa sisältäviä haastatteluaineistoja.

ChatGPT:n teknologiaa hyödynnetään myös esimerkiksi Helsingin yliopiston käyttämässä Atlas.ti-ohjelmassa, jolla tehdään sisällönanalyysia. Ohjelmiston moottorina on täysin sama kielimalli kuin ChatGPT:ssä. Verkkosivuillaan Atlas.ti kertoo, ettei palveluun syötettävää dataa käytetä OpenAI:n kielimallien koulutukseen.

Atlas.ti on tutkijoiden keskuudessa tuttu ja luotettu ohjelma, johon yliopisto on hankkinut tutkijoille lisenssit. Raskin mielestä tilanne voi kuitenkin hämmentää yksittäistä tutkijaa, joka pohtii mihin palveluihin voi luottaa.

”En tiedä mihin Atlaksen kielimalliin syötetyt tiedot päätyvät. Mutta luotan siihen, että yliopisto on hankkinut meille haastatteluanalyysiohjelman lisenssit sitä varten, että niitä käytetään.”

”Tekoäly tarjoaa voimakkaita, nopeita ratkaisuja. Emme kuitenkaan pysty jäljittämään tekoälyn päätelmiä lähteisiin.”

Helsingin yliopistossa ohjeet tekoälyn hyödyntämiselle tutkimuksen teossa ovat vasta kehitteillä. Rask penää yliopistoilta tutkijoita koskevia tekoälyohjeistuksia, sillä nykytilanteessa ei ole selvää, mihin tarkoituksiin tekoälyä on sallittua käyttää ja mihin ei. Myös journaalien tekoälylinjaukset vaihtelevat suuresti.

”Tekoäly tarjoaa voimakkaita, nopeita ratkaisuja vaikkapa editointiin tai artikkelin sisällölliseen rakenteluun. Emme kuitenkaan pysty jäljittämään tekoälyn päätelmiä lähteisiin, mikä sotii tutkijan ammattieetosta vastaan”, Rask sanoo.

Hänen mielestään tämä asetelma luo riskin sille, etteivät tutkijat kerro käyttävänsä tekoälyä apunaan. Tämä on vaaraksi tutkimuksen läpinäkyvyydelle.

”Se on erittäin vaarallista. Sen takia yliopistojen pitäisi pystyä antamaan hyvin selkeitä ohjeita siitä, millä tavoin toimitaan.”

Antti Kailio

Asiantuntija, tiede ja päätöksenteko

Julkaisemme kevään aikana sarjan tekoälyyn liittyviä artikkeleita, jotka avaavat tekoälyn hyödyntämisen potentiaalia ja rajoitteita. Artikkeli on laadittu osana Jane ja Aatos Erkon säätiön rahoittamaa Tieteelliset Ilmiökartat -hanketta. Hankkeessa etsitään uusia ratkaisuja siihen, miten tieteen vaikuttavuutta voidaan edistää ja miten tutkittua tietoa saadaan tehokkaasti kanavoitua päätöksenteon tueksi. Lue lisää Tieteelliset ilmiökartat -hankkeesta.